Cada vez más usuarios utilizan ChatGPT como asistente cotidiano . Para escribir, pensar, organizar sus vidas… pero también para hablar de temas muy personales.

Lo que mucha gente no se da cuenta es que estas conversaciones no son inofensivas. Detrás de cada intercambio, potencialmente se comparte información sensible : emociones, problemas de salud, datos profesionales o financieros.

Según varios análisis recientes, una parte significativa de las conversaciones con ChatGPT tratan temas personales, incluso íntimos, que van mucho más allá del simple uso “productivo” .

Entonces, ¿son realmente privadas tus conversaciones con una IA? Y, lo que es más importante, ¿cuáles son los riesgos de compartir demasiada información ?

Puntos clave para recordar

- Las conversaciones con ChatGPT suelen ser mucho más personales de lo que uno podría pensar.

- El servicio puede almacenar y utilizar los datos introducidos según los parámetros elegidos.

- No existe un nivel de confidencialidad equivalente al que ofrece un médico o un abogado.

- Entre los riesgos se incluyen la fuga de datos, la exposición accidental o el uso indebido.

- Debes limitar la información confidencial que compartes con la IA.

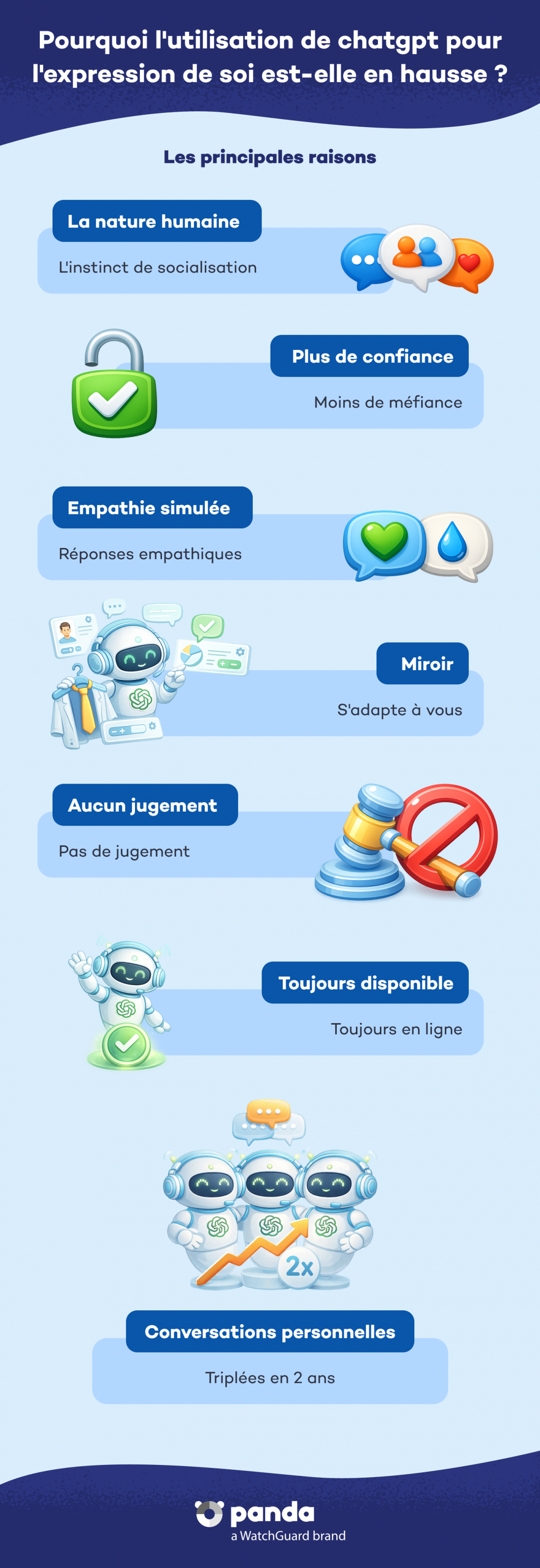

¿Por qué los usuarios comparten tanta información con ChatGPT?

Una relación que se vuelve personal:

ChatGPT está diseñado para ser conversacional, empático y útil. Como resultado, muchos usuarios rápidamente van más allá de los usos puramente técnicos .

Lo utilizan para:

- Hablando de sus emociones: Algunos usuarios describen sus dudas, relaciones o estrés como si se lo contaran a un ser querido, porque la IA les da respuestas estructuradas y tranquilizadoras.

- En busca de asesoramiento personal: a menudo se recurre a la IA para temas delicados como la salud, la crianza de los hijos o las decisiones profesionales, lo que implica compartir información privada .

- Structurer leur vie quotidienne : Organisation, budget, projets… les utilisateurs fournissent des détails très précis pour obtenir des réponses pertinentes, ce qui augmente la quantité de données personnelles exposées.

Où vont réellement vos données ?

Des conversations traitées et parfois conservées :

Lorsque vous utilisez ChatGPT, vos messages sont traités par des serveurs distants.

Selon les paramètres :

- Le service peut stocker les conversations : et les utiliser pour améliorer les modèles ou assurer la sécurité

- Les données peuvent être conservées temporairement : Même lorsque certaines options sont désactivées, des données peuvent être conservées pour des raisons techniques ou de sécurité.

- Le service peut utiliser l’historique : et certaines fonctionnalités permettent à l’IA de “se souvenir” de vos préférences ou informations.

Cela signifie que ce que vous écrivez ne disparaît pas forcément immédiatement.

Une confidentialité limitée

On a souvent l’impression qu’une conversation avec une IA reste dans une sphère privée. En réalité, il faut garder en tête que ce type d’échange ne bénéficie pas des mêmes protections que certaines discussions dans la vie réelle :

- Pas de secret professionnel : Contrairement à un médecin ou à un avocat, une IA n’est pas tenue au secret professionnel. Le service ne garantit donc pas les mêmes protections juridiques pour les informations que vous partagez, même s’il traite vos données selon des règles de sécurite.

- Accès possible dans certains cas : Dans des situations spécifiques, notamment dans un cadre légal ou pour des raisons de sécurité, certaines données pourraient être consultées ou analysées. Cela reste encadré, mais cela signifie que ces échanges ne sont pas totalement hors de portée.

- Aucune garantie absolue : Comme pour tout service en ligne, le risque zéro n’existe pas. Une faille technique, une erreur ou un bug peuvent toujours survenir, même si les plateformes mettent en place des protections avancées.

En clair, mieux vaut considérer ces conversations comme privées dans l’usage… mais pas totalement confidentielles dans l’absolu.

Les risques liés aux conversations avec une IA

Partage d’informations sensibles

Sans forcément s’en rendre compte, beaucoup d’utilisateurs partagent des informations très personnelles lorsqu’ils échangent avec une IA. Cela se fait souvent naturellement, simplement pour obtenir une réponse plus précise ou plus adaptée.

- Des données personnelles : Un prénom, une ville, une situation familiale… ces éléments peuvent sembler anodins, mais mis bout à bout, ils permettent déjà de dresser un portrait assez précis.

- Información financiera: Al solicitar asesoramiento, algunas personas detallan sus ingresos, gastos o planes de inversión, lo que expone datos particularmente sensibles .

- Datos de salud : Los usuarios suelen hablar de sus síntomas, tratamientos o preocupaciones personales, a pesar de que se trata de información sumamente confidencial.

El problema es que, una vez que se comparte esta información, resulta difícil controlar completamente lo que sucede con ella .

Exposición accidental de conversaciones

Incluso sin ninguna intención en particular, algunas conversaciones pueden quedar al descubierto de maneras inesperadas .

Pueden ser:

- Compartido involuntariamente: A veces, basta con enviar un enlace demasiado rápido o sin verificación para que una conversación sea accesible a otros.

- Accesible mediante enlaces públicos : Algunas opciones permiten compartir un intercambio, pero si el enlace se difunde, los usuarios pueden ver el contenido más ampliamente de lo previsto.

- Expuesto debido a un problema técnico: Como cualquier servicio en línea, un error, fallo o vulnerabilidad puede provocar la visualización o el acceso temporal a ciertos datos.

Esto nos recuerda una verdad simple: incluso cuando están bien diseñadas, ninguna herramienta digital es completamente segura .

Pérdida de control sobre los propios datos

Este es probablemente el punto más subestimado. En cuanto se comparte la información, ya no te pertenece por completo .

- Ya no tienes control total sobre su uso: una vez enviada, la información ingresa a un sistema sobre el cual tienes poca visibilidad.

- El servicio puede conservar datos durante un cierto período de tiempo : aunque no siempre sean visibles para el usuario, algunos datos pueden ser almacenados temporalmente por el servicio.

- Puede utilizarse para mejorar los sistemas : el servicio puede usar la información compartida para entrenar u optimizar los servicios.

Esto es lo que llamamos la pérdida de control sobre los datos. Un tema fundamental hoy en día, ya que las herramientas digitales están cada vez más presentes en nuestra vida cotidiana .

Cómo usar ChatGPT sin comprometer tu privacidad

Buenas prácticas esenciales:

Usar ChatGPT a diario no es intrínsecamente arriesgado, siempre y cuando adoptes algunos hábitos sencillos. La clave no es desconfiar de la herramienta, sino mantener el control sobre lo que decides compartir .

- Evite compartir información confidencial: Incluso en un ejemplo o caso hipotético, es mejor nunca compartir datos bancarios, médicos o de inicio de sesión. Este tipo de información no tiene cabida en este tipo de intercambio.

- Anonimato en tus solicitudes: Cuando necesites contexto, acostúmbrate a reemplazar nombres, lugares o situaciones reales con equivalentes ficticios. Esto no afecta la calidad de la respuesta, pero protege mucho mejor tu identidad .

- Revisa tu configuración de privacidad: Las plataformas suelen ofrecer opciones relacionadas con el historial o el uso de datos. Dedicar unos minutos a revisarlas te permite ajustar el nivel de protección según tus preferencias.

- Borra tus conversaciones con regularidad: Limpiar tus mensajes de vez en cuando evita la acumulación de conversaciones con información personal. Es un hábito sencillo, pero efectivo a largo plazo.

- Utiliza contraseñas seguras: una cuenta mal protegida puede exponer todas tus conversaciones. Usar una contraseña segura y única , y si es posible, la autenticación de dos factores, sigue siendo fundamental.

ChatGPT es una herramienta potente y útil que se integra cada vez más en nuestra vida cotidiana. Sin embargo, su uso también se está volviendo cada vez más personal , a veces sin que los usuarios sean plenamente conscientes de ello.

El verdadero problema no es solo tecnológico, sino conductual: lo que eliges compartir .

Si se mantiene alerta y limita la información confidencial, podrá seguir disfrutando de las ventajas de la IA al tiempo que protege su privacidad .