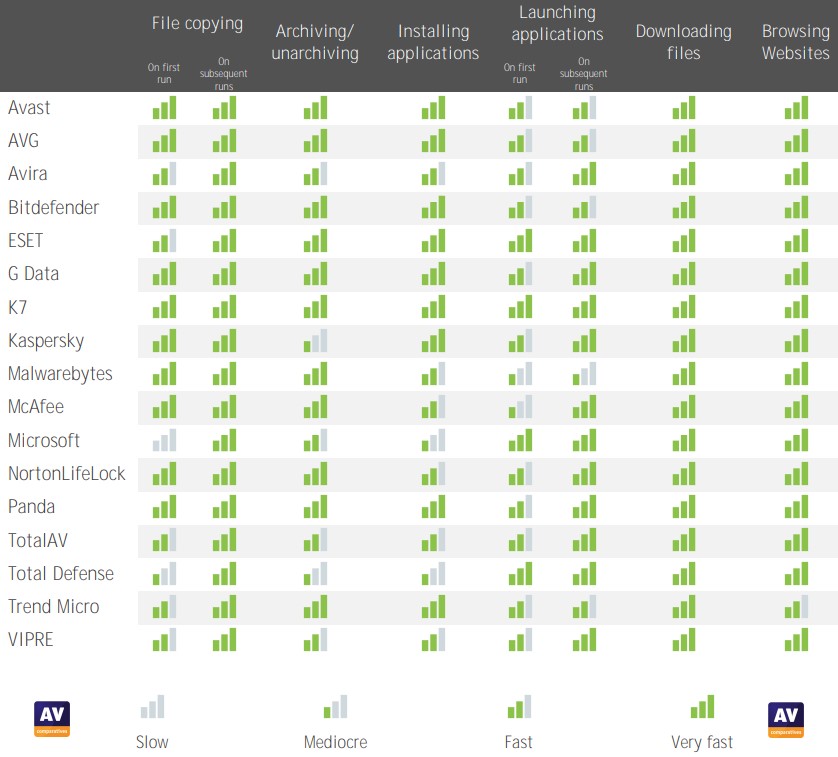

Lo hemos vuelto a hacer. Las pruebas de rendimiento de AV-Comparatives confirman a Panda Free Antivirus como el programa líder en rendimiento de su categoría.

Como cada año, el laboratorio Austriaco ha analizado las 18 soluciones de ciberseguridad más relevantes del mercado en su test de rendimiento. Esta prueba mide el impacto de diferentes software de ciberseguridad sobre el PC. En este caso, para asemejarse lo más posible a un caso común entre usuarios, se ha utilizado un PC de gama baja que funciona sobre Windows 10 con procesador i3, 4GB de RAM y disco duro sólido.

Los resultados, con Panda Free Antivirus a la cabeza, son tan buenos como poco sorprendentes. Porque no es la primera vez que nuestro fiable antivirus gratuito demuestra tener el mejor rendimiento.

“Hace bien poco leíamos artículos y comentarios de algunas personas que se resisten a instalar un antivirus porque ralentiza el ordenador. Esto es un tema del pasado: en Panda llevamos muchísimo tiempo invirtiendo recursos para asegurar que los procesos no afectan al rendimiento de los equipos. No podemos asumir que un usuario ponga en peligro su seguridad en Internet porque un antivirus no le deja trabajar, o que al navegar por la red no puedan cargarse las páginas. No nos centramos únicamente en virus y amenazas. Nuestra prioridad es ser los más eficientes, esto es, ofrecer la máxima protección con el menor consumo de recursos de nuestro ordenador”, afirma Alberto Añón, Consumer Product Manager de Panda Security.

“El terminar en las posiciones más altas de las comparativas, es decir, como el producto que menos impacta el rendimiento del sistema es realmente fabuloso y viene a romper el mito de los antivirus como producto que ralentiza los equipos. Animo a que los usuarios a que prueben nuestros productos gratuitos y lo comprueben por sí mismos”, concluye Alberto Añón.

Qué miden los Performance Test de AV-Comparatives

- Copia de archivos

Se copian archivos de un disco duro físico a otro. Los programas antivirus chequean estos archivos, pero también se sirven de la huella digital para ignorar aquellos que han escaneado antes.

- Archivar y desarchivar

Es de especial interés para quienes trabajan con el PC, pues el almacenamiento de ficheros de trabajo suele verse ralentizado cuando un antivirus examina sus contenidos.

- Instalación de aplicaciones

Los programas que toman parte en esta prueba son de uso común, y se mide el tiempo que dura su instalación.

- Inicio de aplicaciones

En esta prueba entran principalmente aplicaciones habituales con las que trabajan los usuarios en sus PCs. Para ello se abren y crean nuevos documentos de Office (Word, Excel, PowerPoint), así como PDFs en Adobe Acrobat Reade. En este test se consideran también las reaperturas de estos documentos, ya que los usuarios generalmente realizan estas operaciones en repetidas ocasiones.

- Descarga de archivos

Archivos comunes descargados alojados en un servidor de Internet.

- Navegación por sitios web

En esta prueba se mide el tiempo de apertura, carga completa y visualización de sitios web de primera línea con el navegador Google Chrome.

- PC Mark

En último lugar, se abre PC Mark, un benchmark de referencia que mide el rendimiento global del PC.

Desde Panda Security, agradecemos la confianza que nuestros clientes depositan en nosotros cada día. Continuamos con nuestro afán por desarrollar la mejor tecnología para proteger tu seguridad con la mejor solución de ciberseguridad del mercado.