Con un emendamento al decreto Capienze viene proibito l’uso di sistemi di sorveglianza biometrica, ma con una grossa eccezione.

Il parlamento ha approvato un emendamento che blocca l’utilizzo del riconoscimento facciale fino al 31 dicembre 2023, in attesa di una legislazione specifica e coerente con il contesto normativo europeo. Questa moratoria è stata ricevuta positivamente dal Garante della privacy, ma prevede un’eccezione per le autorità giudiziarie.

L’opinione pubblica è divisa su questo provvedimento. Da tempo aspettavamo una legge a tutela del cittadino per frenare l’utilizzo illecito dell’analisi tramite intelligenza artificiale dei dati biometrici, soprattutto per quanto riguarda la sorveglianza in tempo reale. Se da un lato siamo felici che l’Italia sia il primo paese a prendere provvedimenti, dall’altro ci preoccupa che la legge non si applichi alla pubblica amministrazione e alla magistratura.

In questo post vedremmo cosa prevede l’emendamento al decreto, quali sono le eccezioni e le implicazioni per la privacy degli italiani. Continua a leggere!

Cosa prevede la legge

L’emendamento al decreto Capienze ha istituito una moratoria di tre anni, ovvero una sospensione della legalità e quindi la proibizione dell’utilizzo di sistemi di videosorveglianza mediante riconoscimento facciale. La moratoria dovrebbe dare il tempo al parlamento di emanare leggi specifiche per regolamentare l’uso del riconoscimento facciale, del trattamento dei dati biometrici e più in generale della sorveglianza in tempo reale basata su sistemi di questo tipo.

Questo decreto si inserisce in un ampio sforzo a livello europeo di ridefinire il concetto di dati personali alla luce degli ultimi sviluppi tecnologici e dell’evoluzione dell’ecosistema digitale (che coinvolge multinazionali di molti paesi, non tutti orientati alla privacy).

Il problema del decreto non riguarda tanto ciò che include, quanto ciò che esclude: il divieto non si applica ai “trattamenti effettuati dalle autorità competenti a fini di prevenzione e repressione dei reati” se “in presenza di parere favorevole del Garante”.

Le reti neurali sono intelligenti ma non infallibili, e possono rispecchiare errori e pregiudizi di chi le programma.

I pericoli del riconoscimento facciale

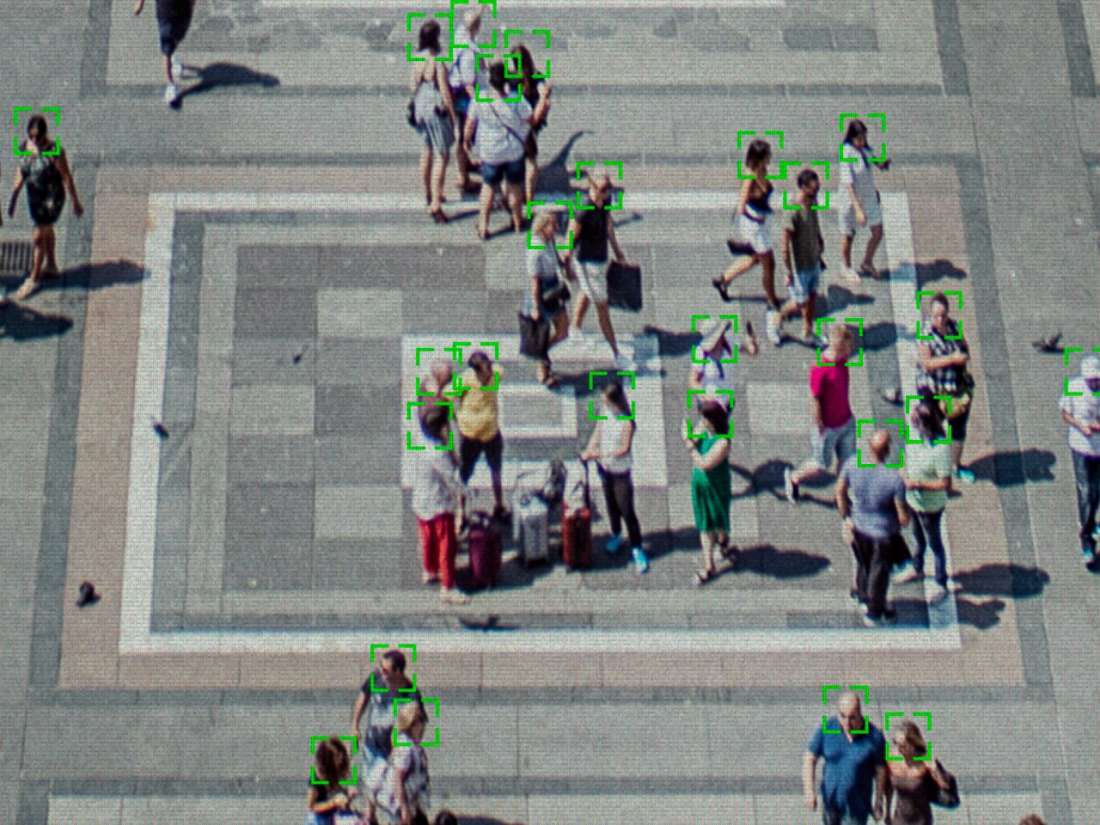

In Europa, da alcuni anni è attivo il movimento Reclaim Your Face, che chiede la protezione dei dati biometrici e la proibizione dell’uso del riconoscimento facciale tramite intelligenza artificiale. Il rischio è che i sistemi di questo tipo vengano usati per creare una rete di sorveglianza continua e onnipresente, cancellando di fatto la privacy dell’individuo.

In questo senso si sono pronunciati anche l’EDPB (il Comitato per la protezione dei dati) e l’EDPS (il Garante europeo della protezione dei dati), chiedendo la proibizione dell’uso dell’AI per il riconoscimento facciale negli spazi pubblici, perché potrebbe portare a comportamenti discriminatori. Questo si deve al fatto che le reti neurali sono intelligenti ma non infallibili, e soprattutto possono rispecchiare errori e pregiudizi di chi le programma e scrive gli algoritmi.

LEGGI ANCHE: Quanto è preciso il riconoscimento facciale?

Altri esperti legali, come l’avvocato Luca Bolognini dell’Istituto italiano per la privacy, ritengono che il testo dell’emendamento sia troppo vago, in quanto non parla direttamente di installazione e, quando utilizza la parola “usare”, non specifica quali siano i casi e le modalità di uso del riconoscimento facciale.

Il pericolo principale per il cittadino è un’ingerenza eccessiva delle autorità nella propria vita, ad esempio riguardo ai propri spostamenti e alla propria immagine. Per questo, la definizione di dati personali si è progressivamente ampliata negli anni per includere anche i dati biometrici tra le informazioni personali, che consentono di identificare una persona in modo univoco.

Infine, ci sono i rischi a livello informatico:

- Hackeraggio dei sistemi informatici e di controllo

- Violazione dei database con i dati biometrici

- Manipolazione dei registri

- Furto di identità digitali biometriche degli utenti finali.

Tecnologie più potenti possono snellire il lavoro delle autorità, ma il rischio per la libertà è alto.

Riconoscimento facciale, andiamo verso il social scoring?

Una delle applicazioni più terribili che possiamo immaginare per il riconoscimento facciale tramite AI è ciò che in Cina è già in fase di sperimentazione dal 2015: il social scoring.

Tramite un monitoraggio costante degli spazi pubblici e dei cittadini, è possibili registrare e catalogare i comportamenti delle persone, associando a ognuna di loro un punteggio (come nell’inquietante episodio della serie Black Mirror). Il punteggio deciderà a quali privilegi (o punizioni) avrà accesso ogni cittadino.

Si tratta di un’applicazione non democratica della tecnologia e del Big Data, che fortunatamente sembra lontana anni luce dalla nostra realtà. Tuttavia, l’idea di una società del controllo appare sempre più realistica e se da un lato tecnologie più potenti possono snellire il lavoro delle autorità (e la protezione dei cittadini), dall’altro il rischio per la nostra libertà è evidente.

Questo discorso vale soprattutto a livello pubblico, perché sul settore privato i legislatori (sia italiani sia europei) sembrano non avere dubbi: divieto assoluto del riconoscimento facciale in tempo reale a scopi di sorveglianza non autorizzata.

Conclusioni

L’emendamento al decreto legge sul riconoscimento facciale ha il sapore di una mezza vittoria. L’Italia era vicina a conquistare un primato positivo nel digitale, ma la vaghezza delle disposizioni ha sicuramente smorzato il sorriso della maggior parte dei cittadini. Dovremo quindi aspettare l’entrata in vigore del regolamento specifico sia su scala nazionale che europea prima di valutare appieno la situazione.

Nel frattempo, possiamo riflettere sui potenziali rischi legati al riconoscimento facciale e al suo impiego tramite intelligenza artificiale e possiamo iniziare a prenderci cura della nostra privacy negli ambienti in cui è già possibile gestire e revocare il consenso al trattamento dei dati.

CONTINUA A LEGGERE: Privacy del cellulare, quanti dati personali inviano gli smartphone?

Buona navigazione e buona protezione dei dati biometrici!